Albania ha dado un paso histórico —y polémico—: se ha convertido en el primer país del mundo en nombrar a una inteligencia artificial como ministra. Su nombre es Diella, inspirado en la palabra «diell» (sol, en albanés), como símbolo de transparencia.

La nueva «ministra» se encargará de evaluar licitaciones públicas, detectar irregularidades y asistir en trámites electrónicos. Su creación responde a un objetivo político muy concreto: convencer a Bruselas de la voluntad de Albania de luchar contra la corrupción de cara a su adhesión a la Unión Europea en 2030.

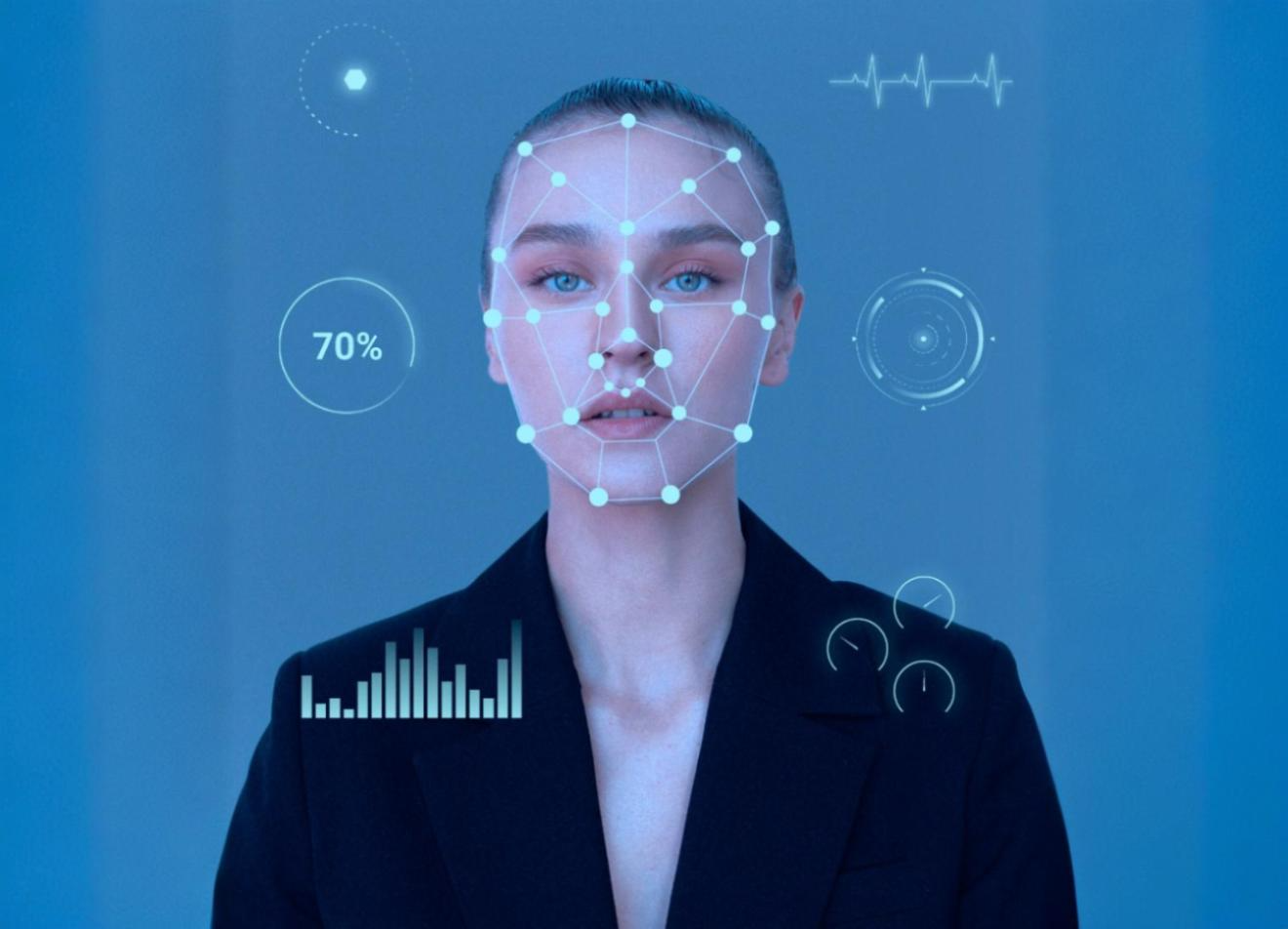

La puesta en escena no ha podido ser más simbólica: en las presentaciones oficiales, Diella aparece como una joven sonriente, con traje típico albanés, saludando desde la pantalla. Sin embargo, tras el gesto de modernidad, surgen muchas incógnitas.

Luces y sombras de la iniciativa

El gobierno albanés pretende mostrar un compromiso con la transparencia en un país marcado por sospechas de corrupción, favoritismo y blanqueo de capitales en las adjudicaciones públicas. Pero el movimiento despierta más dudas que certezas.

Delegar un cargo ministerial en una IA podría ser problemático por varios motivos:

- No se ha aclarado si habrá algún tipo de supervisión humana sobre las decisiones de Diella.

- No han informado sobre cuál ha sido el algoritmo utilizado, los datos de entrenamiento y los mecanismos de validación de sus resultados.

- Como cualquier IA, existe un riesgo elevado de sesgos en las adjudicaciones y de falta de trazabilidad en los procesos.

- Se abren vulnerabilidades de ciberseguridad en un contexto geopolítico delicado.

A estas críticas se suma otro factor: la viabilidad. Según estudios del MIT, el 95 % de los proyectos de IA a gran escala fracasan por falta de retorno o por costes excesivos. ¿Está Albania preparada para gestionar un sistema tan complejo y delicado?

El riesgo de sustituir en vez de complementar

La IA puede ser un aliado poderoso para reforzar la transparencia administrativa, pero su función debería ser acompañar y mejorar el trabajo humano, no reemplazarlo. La sustitución completa de un rol político de alto nivel plantea un escenario inédito y con implicaciones democráticas profundas: ¿quién asume la responsabilidad última de las decisiones?

Otros países ya experimentan con IA en la administración: Ucrania tiene un avatar portavoz, México una asistente virtual judicial, y Brasil avanza en esa línea. Pero el caso albanés va más allá: no es un asistente, sino una «ministra».

Conclusión

Albania busca con Diella enviar un mensaje claro a la Unión Europea: compromiso con la transparencia y voluntad de modernización. Pero el experimento plantea serias dudas de legitimidad, control y seguridad.

La innovación tecnológica es bienvenida, siempre que no sustituya el juicio crítico humano ni ponga en riesgo la confianza en las instituciones. La pregunta sigue abierta: ¿es Diella un rayo de luz contra la corrupción o un salto demasiado arriesgado en la política digital?

Como siempre, cuidad los datos y ¡cuidaos!